你能读懂一只老鼠的情绪吗?当它感到愉悦或恐惧时,脸上会露出怎样的“表情”?尽管我们与小鼠共享着基本的情感大脑回路,但破译它们沉默的面部语言,一直是神经科学家面临的巨大挑战。近期,一项研究借助人工智能技术,首次成功解码了小鼠的情绪密码,发现它们的喜怒哀乐早已写在脸上——尤其是那双“会说话”的耳朵上。

情绪是生物体适应环境、指导行为的重要心理生理过程,其核心维度包括效价(从积极到消极)和唤醒度(从低沉到高涨)。尽管人类情绪研究已建立成熟的自动化面部表情编码系统,但在小鼠等模式动物中,如何客观、精准地从其面部表情识别情绪状态仍是一个巨大挑战。近年来,虽然已有研究尝试将小鼠面部表情与情绪状态关联,但其特异性面部特征及背后的神经机制仍不明确。尤其在实验室环境中,小鼠面部肌肉运动细微、动态变化快,依赖人工观察的传统方法在分辨率、效率和客观性上均存在局限,难以精准捕捉其情绪表达的精细时空动态模式。

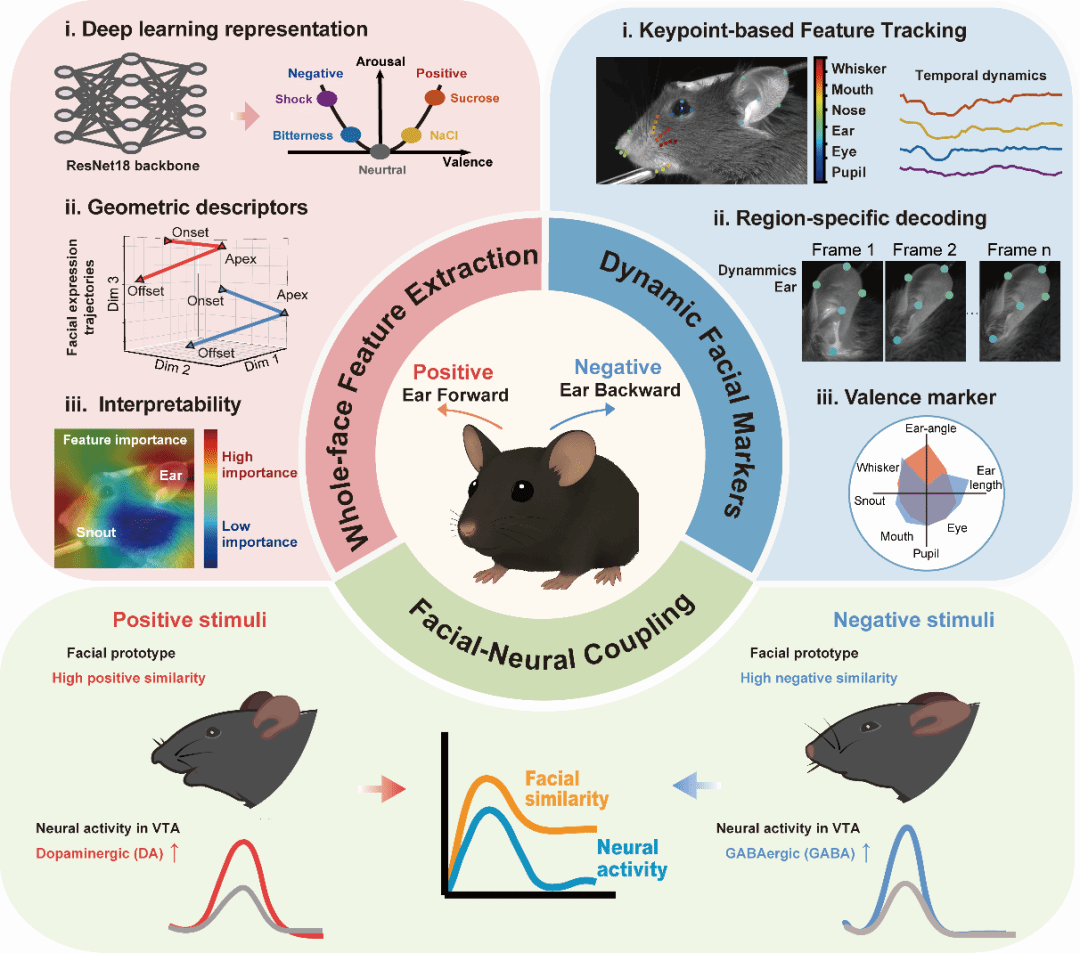

2025年,实验室认知神经科学中心肖晓团队,在Advanced Science期刊发表了题为“Cracking the Valence Code: Patterned Facial Kinematics and Neural Signatures of Emotional Expressions in Mice”的研究论文,博士研究生陈钰佳为本文第一作者。该研究提出了一种基于人工智能的框架,用于解码小鼠的面部表情,揭示了与人类情绪模型相似的效价和唤醒度维度。研究发现,小鼠的面部表情能稳定反映积极和消极的情绪反应,通过药理学操控进行验证。尤其是,面部耳部的动态变化被发现是区分细微情绪差异的关键特征。神经相关性分析和针对腹侧被盖区(Ventral Tegmental Area, VTA)多巴胺能和GABA能神经元的光遗传学抑制进一步证明了面部表情与效价特异性神经活动之间的复杂联系。这些发现为高时间分辨率地解码小鼠情绪状态提供了新的平台,推动了情绪处理机制的理解,并为情绪调节疗法的发展提供了有力支持。

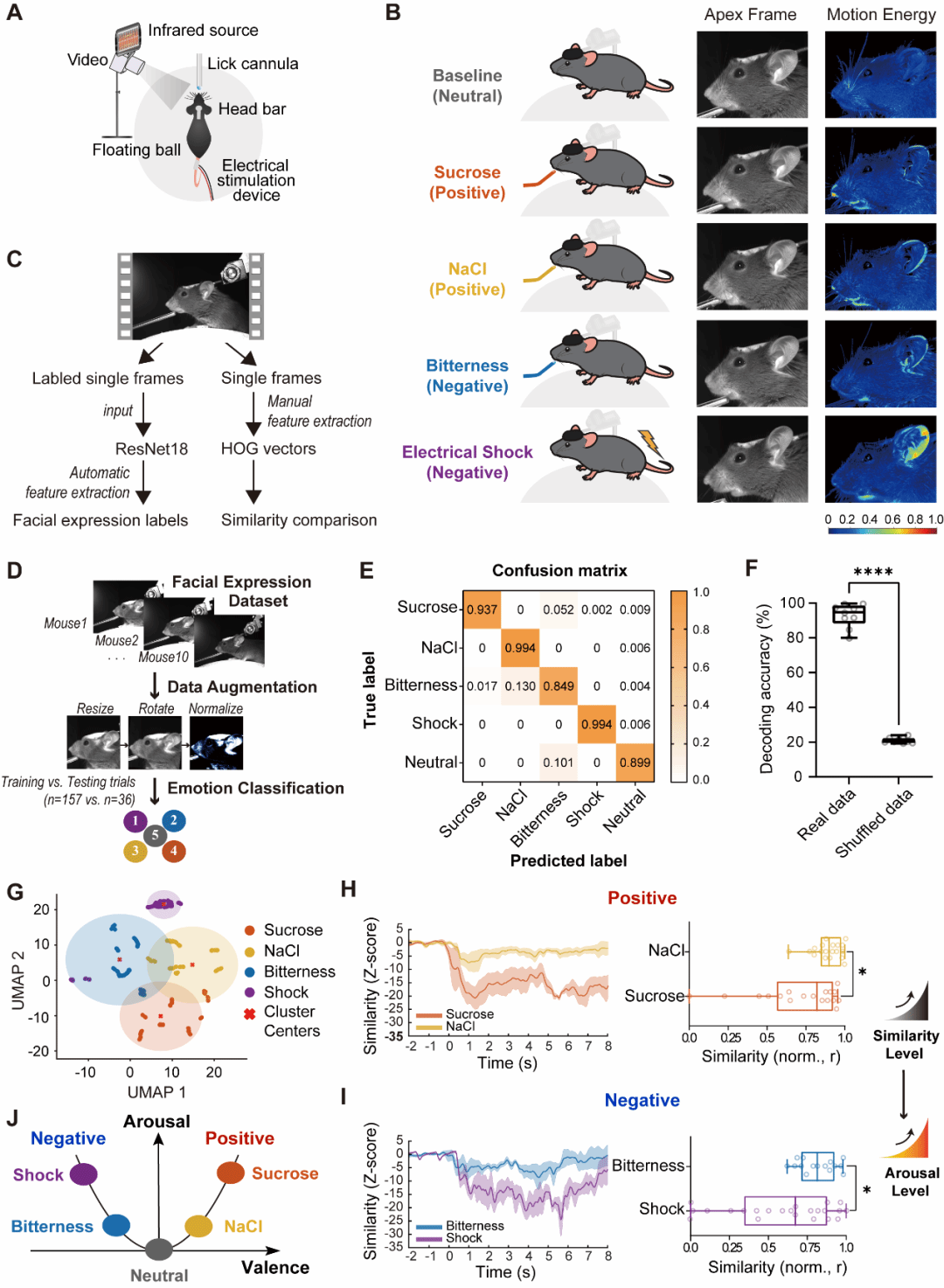

1.为了建立一套客观、量化地解码小鼠情绪状态的系统方法,研究团队开发了一套基于人工智能(AI)的综合分析框架。首先,利用深度残差网络对四种情绪刺激(蔗糖、氯化钠、苦味剂溶液及尾部电击)诱发的小鼠面部图像进行分类,模型在独立测试集上达到93.02%的分类准确率,表明小鼠面部表情具有高度的刺激特异性。为进一步增强模型的可解释性,团队引入Grad-CAM技术对网络决策机制进行可视化分析,结果显示耳部姿态、口鼻部形态及胡须运动等区域在情绪分类中贡献显著,从模型层面揭示了面部局部动态与情绪状态之间的密切关联(图1)。

▲ 图1 小鼠面部表情自动化分析框架

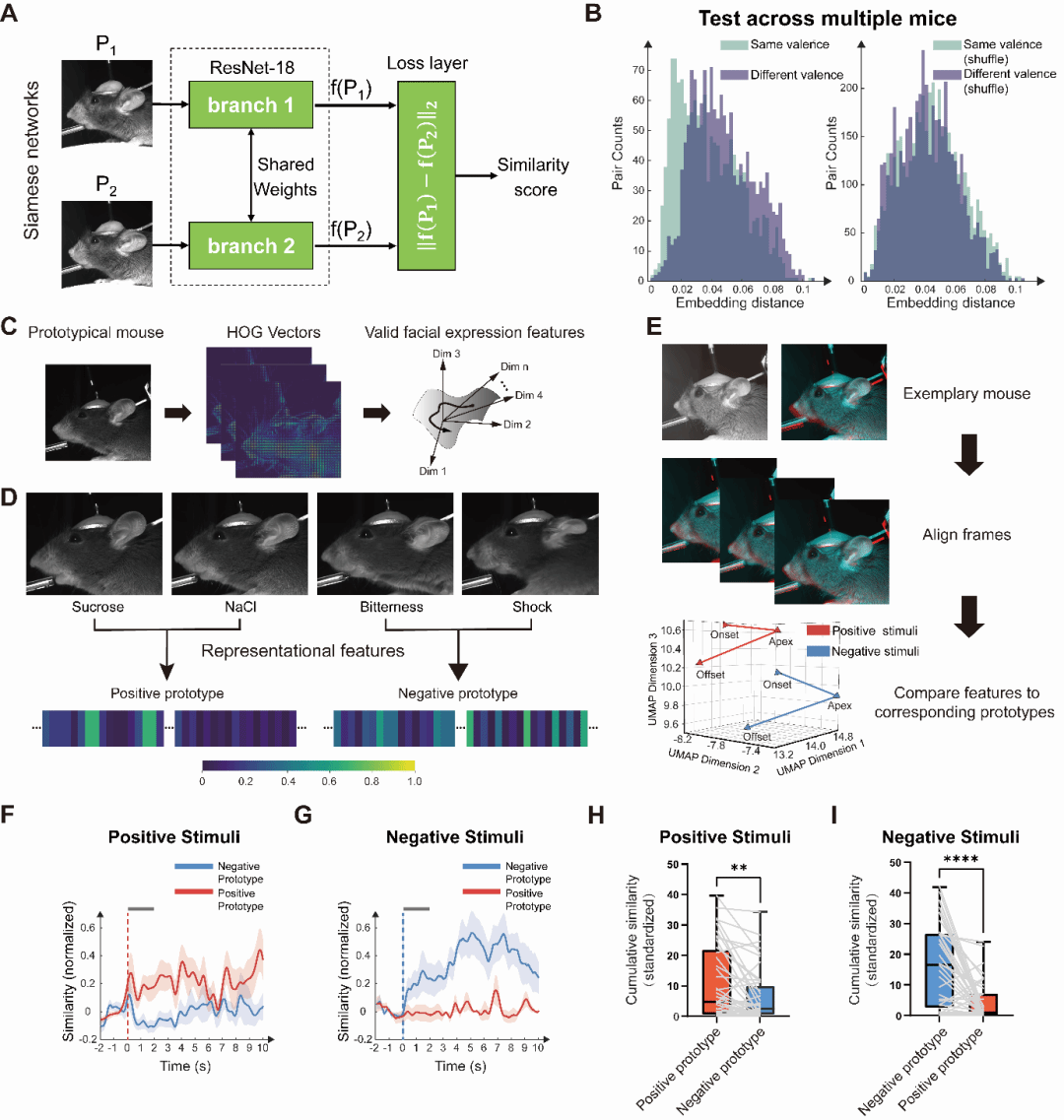

2.为探究情绪表情模式是否具备效价特异性及跨个体泛化能力,研究团队构建了基于孪生网络(Siamese Network)的嵌入学习架构,旨在提取与个体身份无关的效价特异性表征。该网络通过对比学习将同一效价、不同个体的面部表情映射至嵌入空间中的邻近区域,而不同效价表情则显著分离。此外,团队采用方向梯度直方图(HOG)构建了正性与负性效价的“原型表情”。结果表明,无论是端到端的深度学习方法还是基于特征工程的传统方法,均能有效捕获跨个体稳定存在的效价编码模式,为构建泛化性强的情绪解码模型奠定基础。长时程药物干预实验进一步验证了正负效价表情模板的有效性,其中对致幻剂的反应结果表明,该原型模型具备解析先前未表征情绪状态的潜力(图2)。

▲图2 基于面部表情的效价特异性模型

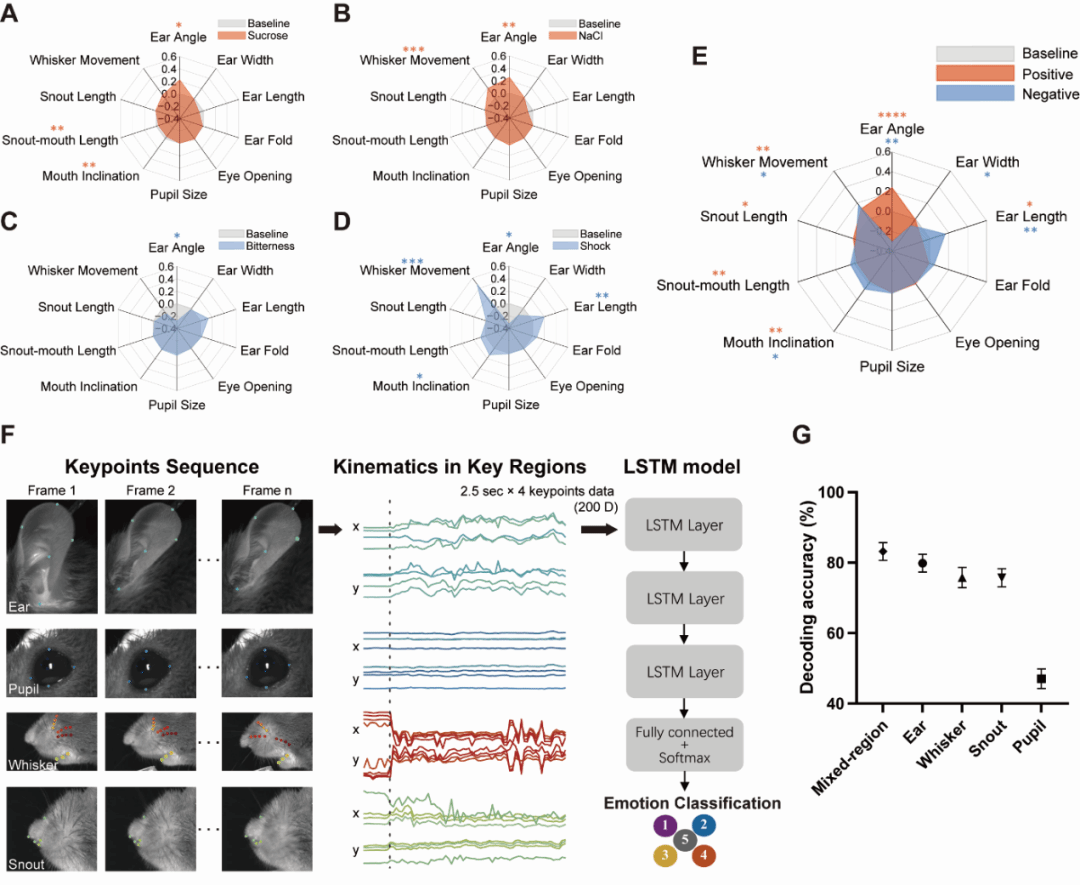

3.为进一步精细量化面部动态特征,本研究引入基于DeepLabCut的关键点追踪技术,实现了对37个面部标志点(涵盖鼻部、嘴部、眼部、胡须及耳部区域)的运动学分析。研究团队发现,小鼠面部表情是由情绪效价特异的、多区域协调运动构成的整体模式。其中耳部运动参数在区分情绪效价方面表现出最高的判别力:正性情绪下耳部呈现前倾姿态,而负性情绪下则出现明显的后移。基于长短期记忆网络(LSTM)对时序运动模式的解码结果进一步表明,耳部运动轨迹可作为情绪状态分类的核心指标(图3)。

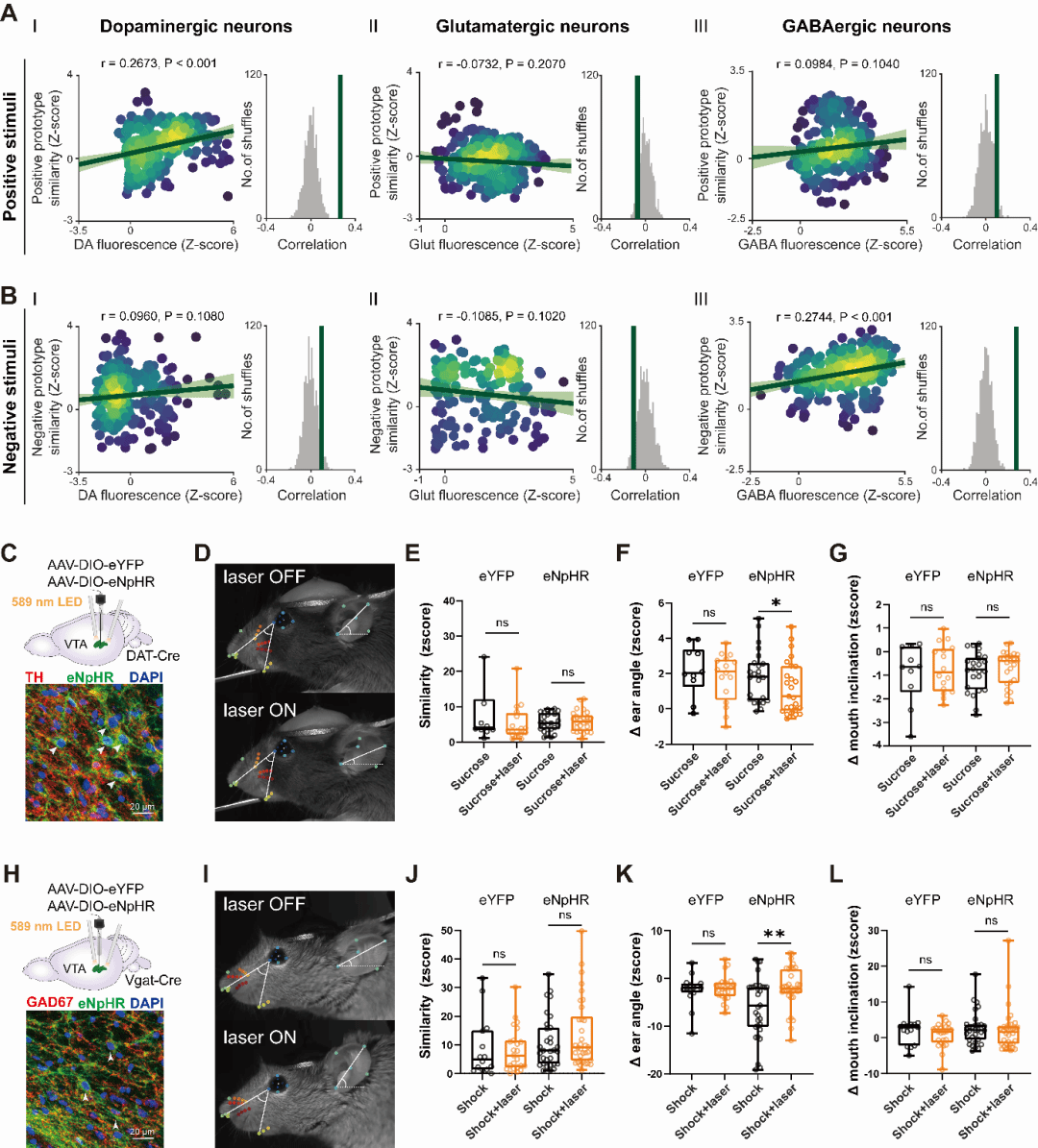

4.为阐明情绪表达的神经机制,本研究整合了高时间分辨率的面部行为记录与VTA区细胞类型特异性的光纤光度记录。神经活动分析显示,多巴胺能神经元在正性刺激下钙信号显著增强,且其活动强度与正性表情动态呈正相关;相反,GABA能神经元主要在负性刺激下激活,并与负性表情同步变化。通过光遗传学实验,研究进一步发现了VTA神经元活动对情绪表情的区域特异性调控:抑制多巴胺能神经元显著减弱正性刺激诱发的耳部前倾运动,而抑制GABA能神经元则选择性干扰负性表情中的耳部后收反应。这些结果揭示了中脑腹侧被盖区在情绪加工中的关键作用(图4)。

▲ 图4 光遗传抑制VTA不同神经元诱发面部表情特定区域变化

综上所述,本研究通过整合机器学习、计算机视觉与神经科学技术,构建了一套可客观量化的小鼠正负性情绪解码系统,并在此基础上揭示了与人类情绪结构类似的“效价-唤醒”二维模型特征。通过对多区域协调运动的精细分析,首次确立耳部运动为区分情绪效价的关键行为指标。在神经机制层面,研究明确了VTA区多巴胺能与GABA能神经元分别特异性调控正负性表情的生成。该研究框架克服了传统行为学方法的主观依赖,为情感状态的量化、客观与可重复研究提供了新路径。然而,本研究亦存在一定局限:实验在受控环境中使用头部固定的小鼠模型,在一定程度上限制了情绪反应的自然表达。未来研究可引入自由活动条件下的面部追踪系统——例如头戴式相机、多视角成像平台或反射标记辅助耳部运动捕捉——以促进自发、自然表情的涌现,并在更复杂的行为背景下验证耳部动态作为情绪指标的有效性,尤其适用于不具备专用机器视觉基础设施的实际应用场景。

▲ 图5 文章总结图,表明小鼠面部表情和神经活动的动态解码框架

原文链接:http://doi.org/10.1002/advs.202417156